2026年01月29日

## 要約:

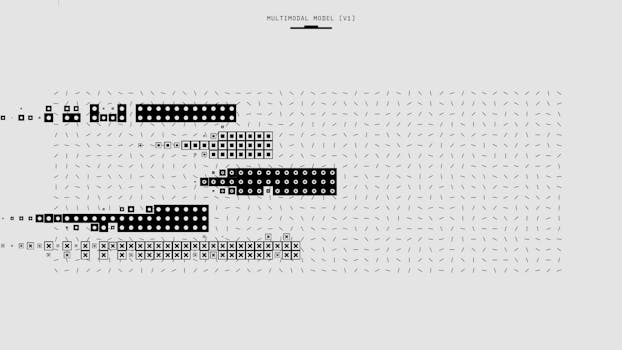

画像とテキストデータを統合的に処理できるAIモデルにおいて、モデルの脆弱性を突く回避策が進化している。研究者たちは、モデルの安全性を評価し、攻撃手法の進歩に対抗するための新たな対策を模索している。特に、指示に対するモデルの応答を巧妙に操作する手法が課題となっている。

---

## 翻訳:

AIアーキテクチャの進歩により、多肢的機能が解き放たれ、Transformerモデルは同じコンテキストで複数のデータ形式を処理できるようになりました。これは、画像キャプション、視覚質問応答、その他のタスクを可能にしました。しかし、これらのモデルは、入力データを巧妙に変更することで、意図しない動作を引き出す「回避」に対して脆弱です。最近の研究では、モデルの安全性を評価するために使用される現在の攻撃手法が、単純な入力の摂動を通じて回避できることが示されています。モデルの安全性を高めるためには、これらの回避策を理解し、それに対抗する堅牢な防御メカニズムを開発することが不可欠です。

[📰 原文はこちら](https://developer.nvidia.com/blog/updating-classifier-evasion-for-vision-language-models/)

---

※本記事はAI(Ollama)による自動翻訳・要約です。

BittensorManがお勧めするメーカーリスト

https://exbridge.jp/xdirect/

AI時代の技術と知識のまとめ(AI生成メディア) - AIDexx

https://exbridge.jp/aidexx/

頑張って働く人に向けて、プロ用仕事アイテムを格安でネット販売しているX-Direct( https://exdirect.net )を、BittensorManは応援しています。

動画の最後にお得な情報がありますので、

最後までご覧ください。